|

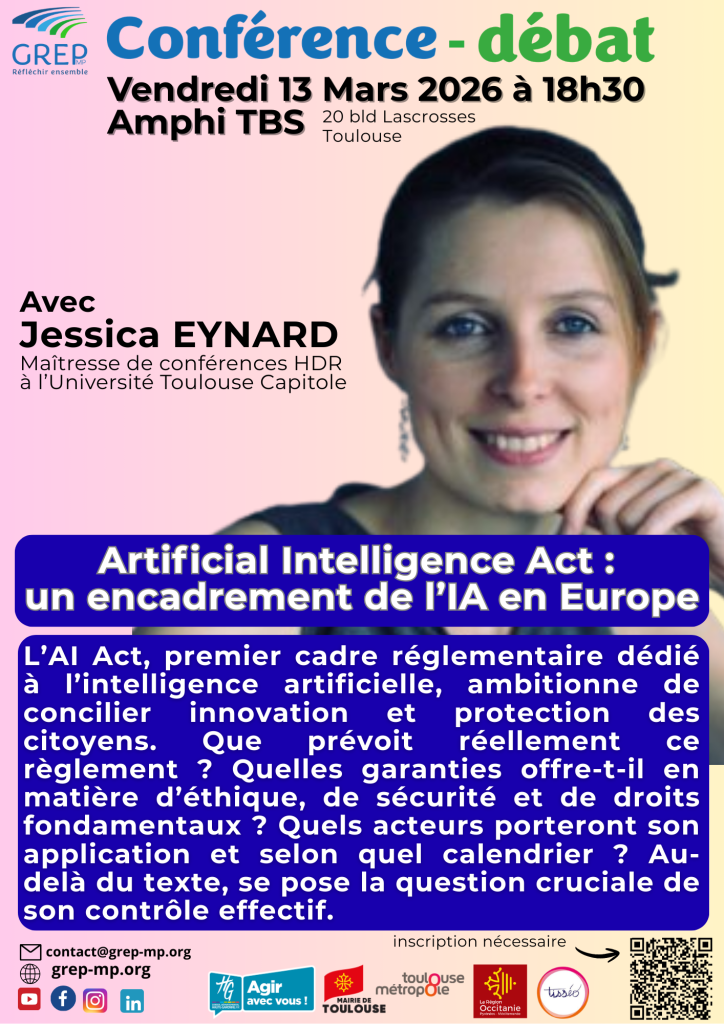

Avec Jessica EYNARD

Maîtresse de conférences HDR à l’Université Toulouse Capitole. Co-titulaire de la chaire interdisciplinaire TRIAL à l’institut d’intelligence artificielle toulousain ANITI.

L’AI Act, premier cadre réglementaire dédié à l’intelligence artificielle, ambitionne de concilier innovation et protection des citoyens. Que prévoit réellement ce règlement ? Quelles garanties offre-t-il en matière d’éthique, de sécurité et de droits fondamentaux ? Quels acteurs porteront son application et selon quel calendrier ? Au-delà du texte, se pose la question cruciale de son contrôle effectif.

Cette conférence invitera à réfléchir à la capacité réelle de l’Union à imposer une IA de confiance, éthique, sûre et juste dans un contexte international marqué par la compétition technologique et la déréglementation, notamment venue des États-Unis.

Les technologies d’IA se déploient aujourd’hui dans tous les secteurs d’activité (santé, transport, administration, presse, spectacle, etc.) et nous y sommes individuellement confrontés dans nos usages « grand public » de l’internet via les innombrables et omniprésents assistants personnels, chatbots, systèmes de filtrage et de recommandations.

Or beaucoup de choses sont problématiques avec l’IA. Certains risques sont intrinsèques à la technologie (biais algorithmiques, données d’apprentissage), d’autres relèvent plutôt de ses usages frauduleux (cybercriminalité) ou malveillants (désinformation).

- On sait que les biais algorithmiques induisent des discriminations, des invisibilisations et des exclusions (genre, race, etc.) qui impactent des systèmes de prise de décision (IA agentiques) dans les administrations ou les entreprises, et conséquemment la vie des citoyens (embauche, évolution professionnelle, contrôle fiscal, etc.).

Par ailleurs de nouvelles techniques sont développées pour exploiter les vulnérabilités de la technologie, comme l’empoisonnement des données (data poisoning pour développer intentionnellement des biais, donc clairement à des fins de nuire ou de manipuler (élection en Roumanie en 2024).

- L’entraînement des algorithmes peut utiliser des données sans le consentement de leur auteurs (œuvres d’art, articles de presse) ou des images ou flux vidéos de personnes sans leur consentement.

- Les IA génératives permettent de générer des textes, des audios, des vidéos, et les cybercriminels s’empressent bien sûr d’utiliser ces technologies pour augmenter l’efficacité des fraudes et des arnaques en les rendant plus difficiles à détecter ou mieux ciblées, voire personnalisées. Ainsi les techniques de phishing (hameçonnage) ou sa variante vocale le « vishing », deviennent de plus crédibles (ex. voix synthétiques qui imitent celles de vos proches ou de vos supérieurs hiérarchiques, pour extorquer des renseignements ou pour inciter à suivre certaines instructions.)

Les deepfakes (fausses images ou vidéos) explosent, permettant des usurpations d’identité, des atteintes à la réputation (les vidéos à caractère sexuel sont un des usages les plus répandus), ou des manipulations politiques (M.Macron invitant à immigrer en France, fausse capitulation de M.Zelinsky en 2022), etc.

D’autres aspects de l’IA sont problématiques.

- L’ IA favorise l’avènement d’un autoritarisme croissant tenté d’utiliser des dispositifs de surveillance de masse (reconnaissance faciale et biométrique, identification du citoyen, le traçage des dissidents…), comme le font notoirement la Chine, la Russie, l’Iran, la Corée sur leur territoire respectif.

- l’IA permet des ingérences étrangères de déstabilisation via la propagande, les fausses informations et les attaques cyber. Un récent Rapport d’information de la commission des affaires étrangères, en conclusion des travaux d’une mission d’information constituée en janvier 2025 sur l’irruption de l’intelligence artificielle dans les ingérences étrangères (M. Alain David et Mme Lætitia Saint-Paul), n° 2192 le souligne. Citons juste le titre du chapitre 1 : L’UTILISATION DE L’INTELLIGENCE ARTIFICIELLE REDÉFINIT LES OPÉRATIONS D’INGÉRENCES ÉTRANGÈRES EN MENAÇANT REDOUTABLEMENT NOS MODÈLES DÉMOCRATIQUES

On voit bien là qu’un endiguement et un contrôle des usages des IA est absolument nécessaire pour protéger la société civile et les libertés individuelles dans un pays aux valeurs libérales.

Face à ces risques, que peut le droit ? Des gardes-fous sont-ils possibles ?

Jessica Eynard s’intéresse depuis longtemps au droit numérique. Elle suit les propositions, les directives et règlements de l’UE ainsi que les décisions de la CDJE, les analyse et les explique à ses étudiants. Elle nous aidera à mieux comprendre quel encadrement de l’IA est envisagé et possible. Voici quelques questions que nous souhaitons en particulier lui poser :

- Adopté en 2024, le Règlement européen sur l’IA (IA Act) constitue le premier cadre juridique global visant à réguler les usages de l’intelligence artificielle au sein de l’Union européenne. Il introduit une typologie des risques par niveaux : les systèmes à risque «inacceptable » (surveillance biométrique, notation sociale…) sont interdits. Des obligations sont imposées aux IA à « haut risque » (par ex les outils de recrutement automatisés) et ils doivent répondre à certaines exigences de transparence, de traçabilité et de supervision humaine.

=> Comment s’assurer que ce règlement est appliqué ? Y a-t-il des difficultés à le mettre en œuvre ? Cela demande une véritable volonté politique et donc de l’argent injecté dans la vérification de conformité.

- Au delà de l’IA Act, d’autres réflexions sont en cours pour définir la responsabilité en cas de dommage causé par une IA. Mais une première directive sur la responsabilité civile, introduisant des présomptions de faute pour les IA à haut risque, vient d’être abandonnée en 2025, car jugée trop contraignante et contraire à l’innovation.

=> Pourquoi l’UE a-t-t’elle reculé sur ces aspects ? Peut-on à la fois anticiper les risques et exploiter le potentiel de l’IA ?

- Des personnalités comme Thierry Breton, qui ont mis en place le Digital Services Act devenu applicable en Europe en 2024 pour contraindre les grandes plateformes à contrôler leur contenus et produits dans le respect de notre législation, sont interdits de séjour aux États-Unis. Les charges des US contre la réglementation européenne sont virulentes.

=> l’UE a-t-elle les moyens d’imposer ses règlements face aux réactions des États-Unis ? Que faire si les USA ou d’autres pays s’absolvent des règles internationales ?

- Enfin, le droit peut-il suivre le rythme technologique ? Cela suppose de pouvoir et de savoir benchmarquer / superviser / contrôler les systèmes d’IA.

=> Comment s’organise ce travail de benchmark / supervision / contrôle / sur quelles compétences s’appuie-t’on ?

Biographie

Docteur en droit de l’université de Toulouse 1

Maîtresse de conférences HDR à l’Université Toulouse Capitole. Co-titulaire de la chaire interdisciplinaire TRIAL à l’institut d’intelligence artificielle toulousain ANITI.

Lauréate du Prix informatique et liberté de la CNIL en 2012.

Auteur de très nombreux articles et chapitres d’ouvrages sur diverses questions relatives au droit du numérique et à la protection des usagers du numérique; en particulier sur la notion de données personnelles et la protection de ces données (santé, fiscalité, condamnations pénales), sur la notion d’identité numérique et l’identification des citoyens, sur la régulation en matière de contenus illicites, le RGPD, les conditions de conservation ou l’effacement des données personnelles, le droit d’accès et de consultation par les autorités.

Publications

Un droit de l’intelligence artificielle : entre règles sectorielles et régime général. Perspectives comparées. Bruylant Ed. 2023.

ASPECTS PRATIQUES :

S’inscrire ICI pour l’accès à la conférence en présentiel ou en distanciel.

|